Apple 正在研究AirPods可以使用类似于 Face ID 中使用的传感器来读取用户的嘴唇并处理用户想要的内容,即使没有语音请求。

Apple 一直在研究 AirPods 检测手势的想法超过五年,包括此类检测器如何可以学习用户的独特动作。2024 年,第一个显著结果这项研究是如何AirPods Pro可以检测到用户何时点头或摇头。

现在在新授权专利,苹果透露,它的目标是走得更远。“可穿戴皮肤振动或静音皮肤手势检测器”专利建议使用所谓的自混合干涉测量法来识别更细微的手势。

除了点头或摇晃等完整的头部运动外,还可以检测到更小的运动,如微笑或耳语命令。皮肤变形或皮肤和肌肉振动可以通过干涉测量传感器发现和解释。

Apple 确实采取了其通常的专利方法,并试图在从 AirPods 到眼镜的所有领域为该技术建立先例。但在每种情况下,其理念都是,当用户说话时,下巴和脸颊的运动是可以检测到的。

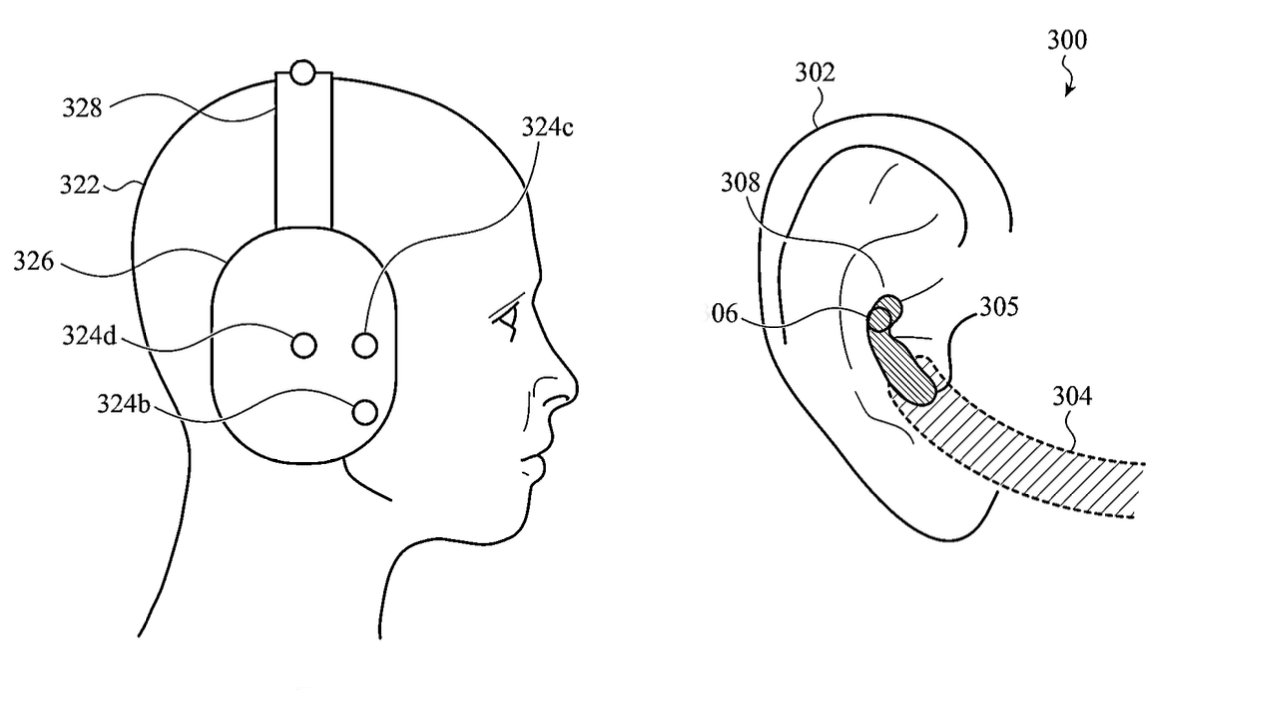

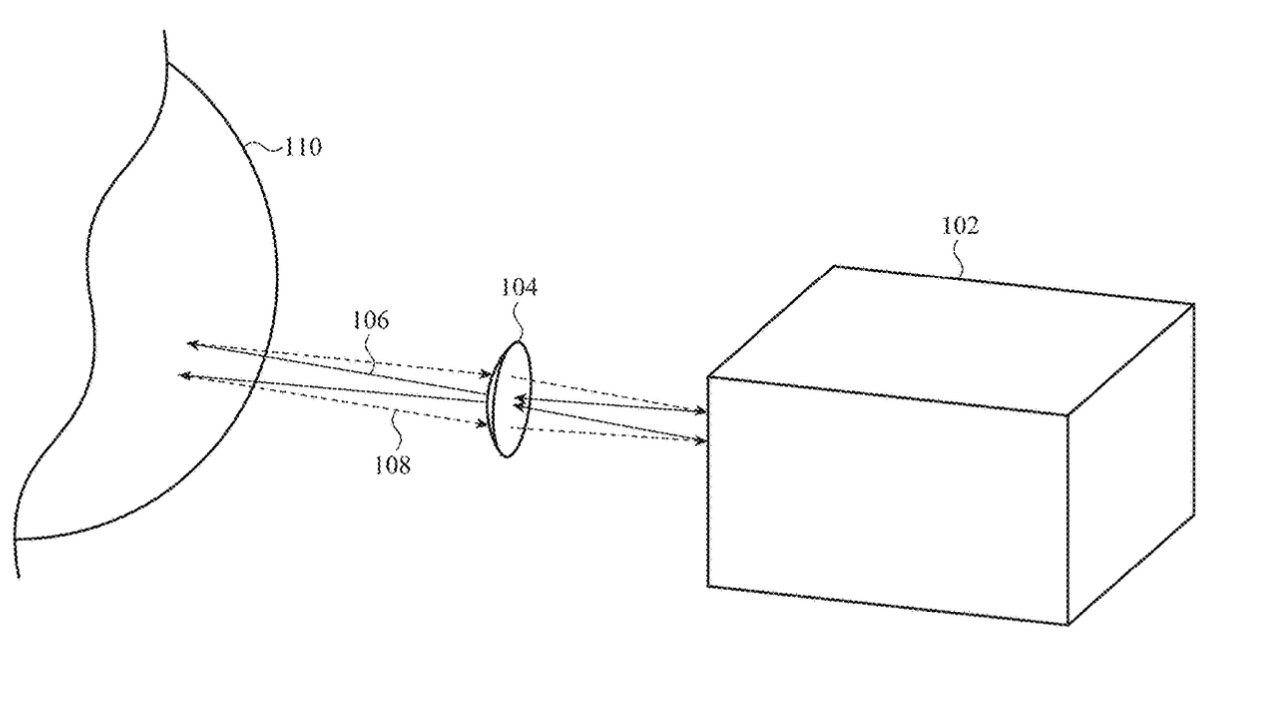

它可以通过在设备框架中使用垂直腔面发射激光器 (VCSEL) 来检测。这个想法是 VCSEL 发射器和传感器,类似于 Face ID 中使用的组合,可以位于设备的框架中。而且,用户可以选择 AirPods 对发射器和传感器组合拾取的不同皮肤和嘴唇运动的反应。

如果 AirPods 位于耳内,而不仅仅是耳内AirPods Max,Apple 还表示,“自混合干涉测量传感器可以将光束引导到用户耳朵中的某个位置。

当该光及其反射回传感器时发生变化,那将是由于头部或皮肤和肌肉运动。然后,该专利专门介绍了可以检测此类运动的方法,但除了具体细节之外,还有两个明显的好处。

一个是移动检测允许 Apple 所谓的静默命令。目前,AirPods Pro 支持通过无声点头或摇头来接听或拒绝电话,但它们可以设置为将嘴部动作解释为“跳过曲目”。

Apple 表示,这是专门为了解决用户可能无法在不被听到的情况下向可穿戴电子设备输入命令的情况。但是,当用户可以说话时,检测皮肤或头部的振动也很有用——因为这种动作可以是一种身份验证。

目前,耳机和 Apple Watch 等设备会检测到用户的声音,或者它们会响应真实或虚拟按钮的按下。然而,所有这些都有局限性。

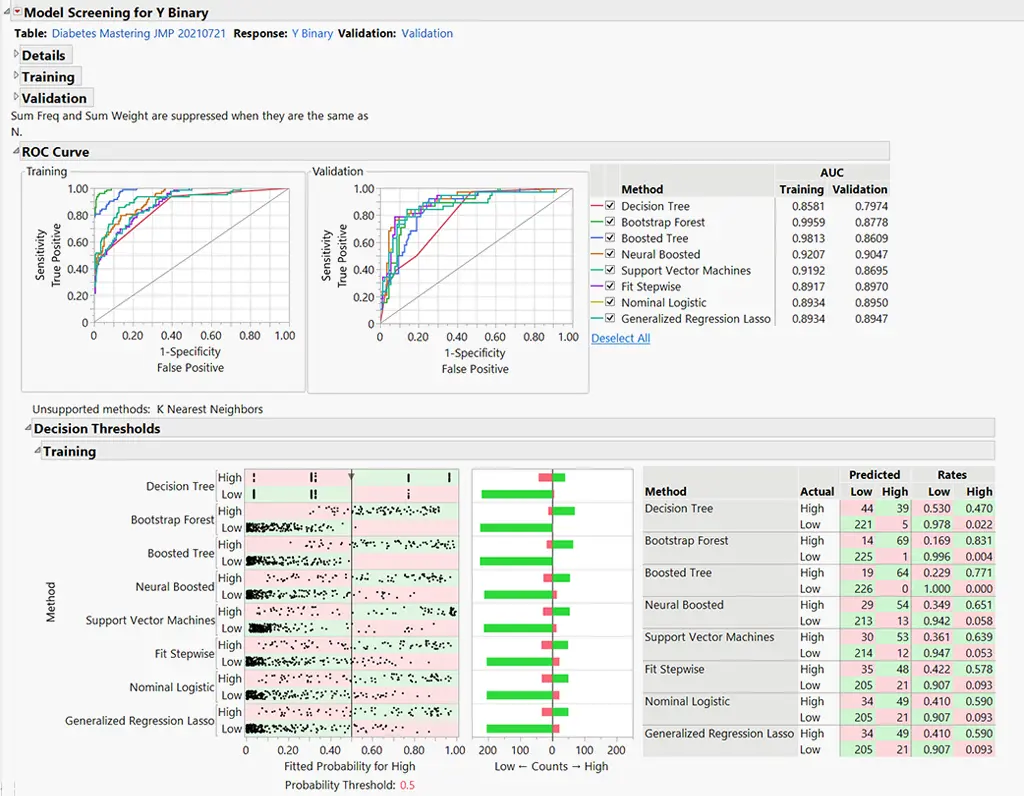

专利细节显示传感器的光如何检测耳朵和皮肤运动 — 图片来源:Apple

专利细节显示传感器的光如何检测耳朵和皮肤运动 — 图片来源:Apple具体来说,语音识别需要首先确保说话的是 AirPods 所有者。屏幕上的按钮或物理按钮需要用户腾出一只手来按下它们。

因此,在这项拟议的技术下,如果 AirPods 佩戴者要求Siri大声,AirPods 可以检查这种运动。最基本地说,如果在收到声音命令时没有这种皮肤振动,AirPods 可以得出结论,用户没有说出它。

因此,无论用户是喊出命令、低声说出命令,还是只是说出命令,AirPods 都可以做出响应。

这项新授予的专利归功于包括 Mehmet Mutlu 在内的两位发明家。他还在2021 年专利申请该研究着眼于使用超声波传感器来验证用户的声音Apple Watch.