苹果继续专注于AI驱动的图像修改,新研究详细介绍了评估框架和一个能在秒内将2D图像转为3D场景的AI模型。以下是该公司研究揭示的内容。

随着iOS 26的推出,苹果使将二维照片转换为三维“空间场景”成为可能,提供了更具动态感的观看体验和深度感。如今,这家iPhone制造商发布了与同一概念相关的更多研究,但成果更加令人印象深刻。

在2025年12月发布的其他研究论文中,苹果公布了一项名为“Sharp Monocular View Synthesis in Less Than a Second”的科学研究。该研究可在苹果机器学习博客上找到,详细介绍了一个名为“SHARP”的开源AI模型,它能在不到一秒内将2D图像转换为3D场景。

同样与借助AI修改图像相关,该公司发布了一篇关于文本引导图像编辑评估框架的研究论文。另一种评估方法检验了AI模型对英语以外语言底层语言复杂性的理解程度,特别是在屈折形态学方面。

以下是研究论文本身揭示的内容。

SHARP —— 在不到一秒内从2D图像生成3D场景

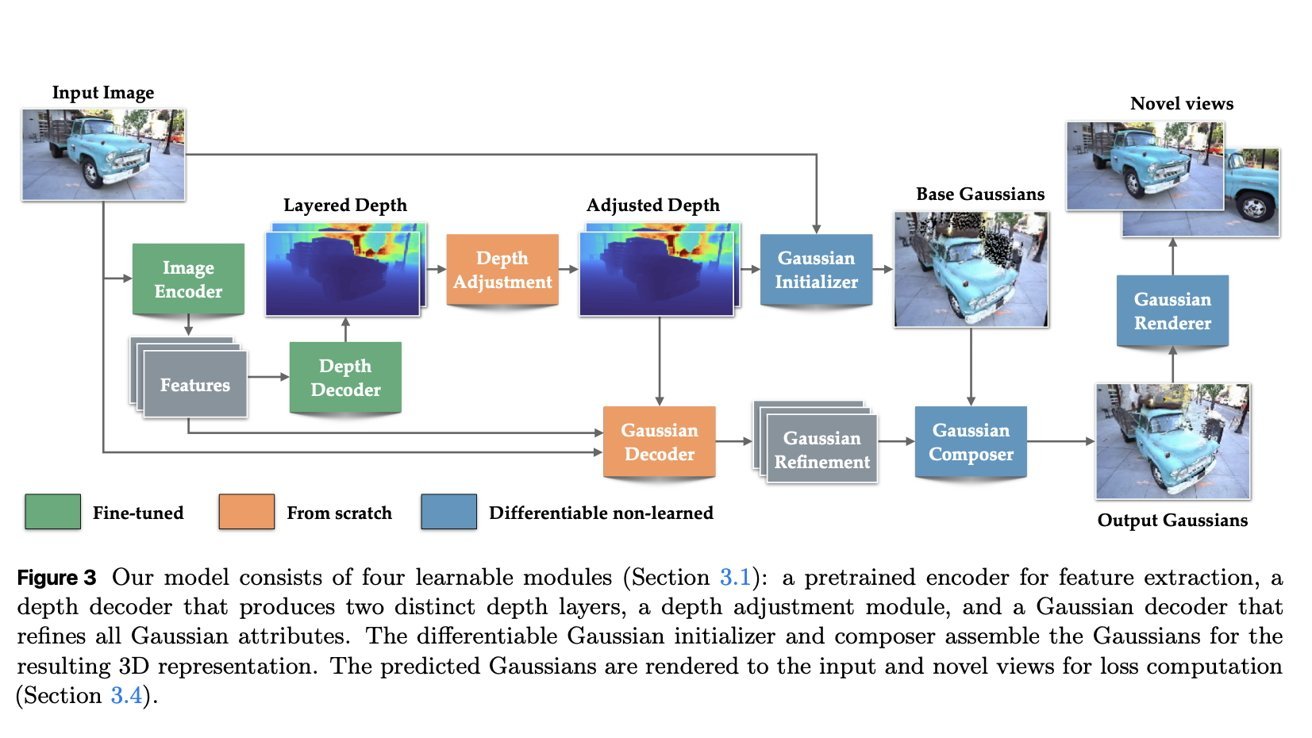

SHARP是一个AI模型,被描述为“一种从单图像进行逼真视图合成的方法”。当提供单张图像时,SHARP“回归出所描绘场景的3D高斯表示参数”。根据该研究,这在典型GPU上可在不到一秒内完成。

SHARP能在不到一秒内生成3D场景。图片来源:苹果。

与使用三角形表示3D场景不同,高斯表示通过数百万个椭球体或斑点来渲染体积。实质上,数百万个这样的斑点组合在一起用于表示3D图像。实现这样的3D表示通常需要从不同视角和角度拍摄同一物体或区域的多张照片。

然而,苹果的SHARP仅需一张图像,并且在典型GPU上使用时能在不到一秒内生成3D场景。该过程仅涉及“通过神经网络的一次前向传播”,但达到这一步花费了时间。

该公司的研究人员在相对大型的数据集上训练了SHARP,旨在使模型能够辨别常见的深度模式。

目标是让SHARP预测3D场景的深度,并基于该预测生成3D高斯表示。

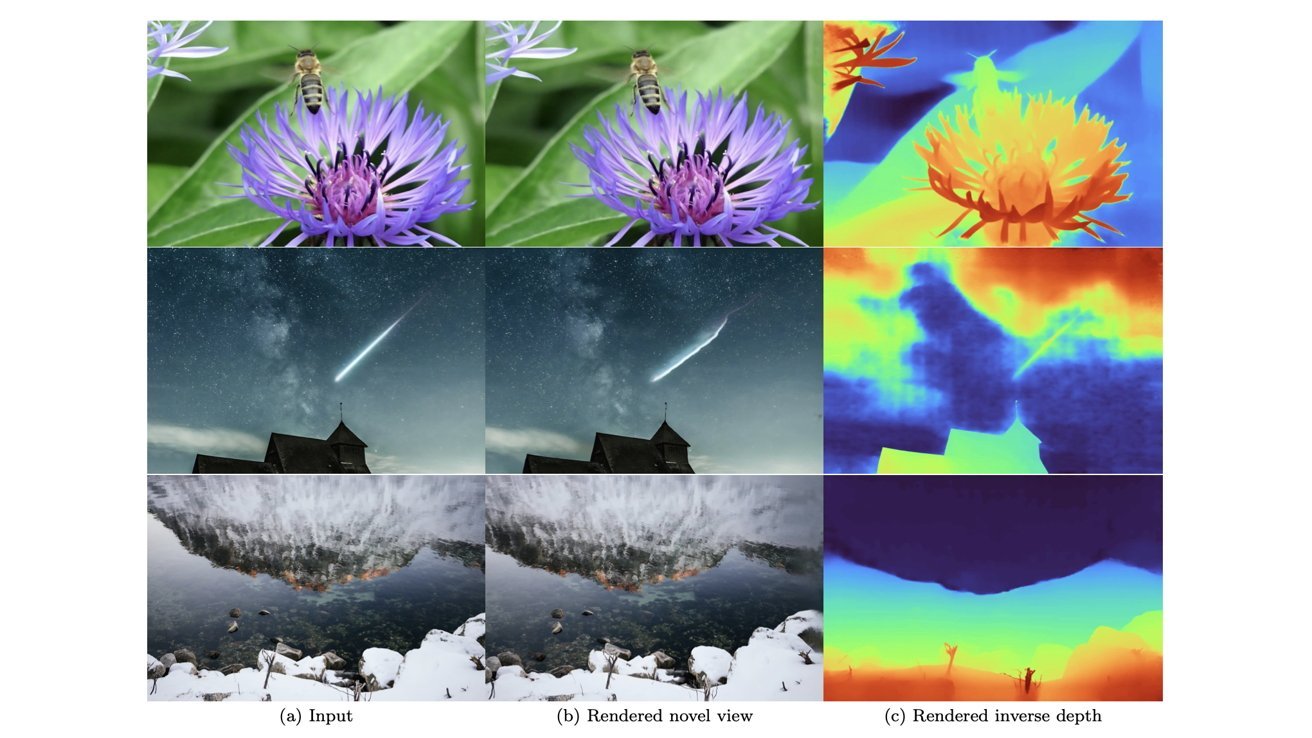

SHARP在特定场景下会失败。图片来源:苹果。

在大多数情况下,该模型成功完成了其创建目的;然而,也存在失败情况。苹果的例子包括物体被渲染在错误位置,例如蜜蜂被放在花朵后面而不是上面,或者天空被解释为附近的曲面。该模型在处理复杂反射时也可能遇到问题。

另一个限制是SHARP仅基于图像的可见部分生成场景,意味着它不会尝试“填补空白”来创建更大的3D环境。即便如此,这个AI模型仍然非常令人印象深刻,甚至已在GitHub上公开可用。

虽然SHARP专注于创建3D表示,但苹果也发布了围绕编辑2D图像和输出质量的研究。

GIE-Bench —— 评估基于文本的图像编辑

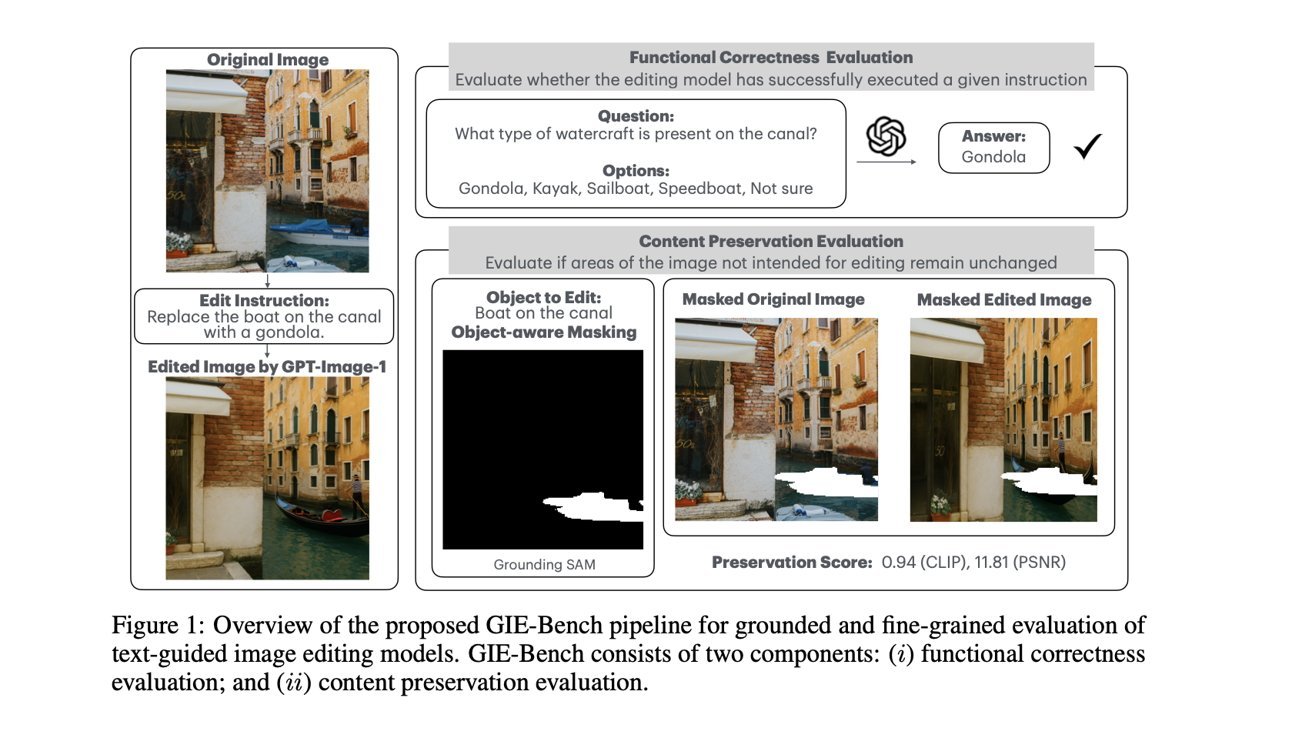

苹果的研究人员设计了一个用于基于文本的图像编辑的评估框架,该框架根据功能正确性和图像保存度对AI模型输出进行评分。

苹果设计了一个用于评估基于文本的图像编辑的框架。

功能正确性通过自动生成的多项选择题进行评估,旨在验证请求的更改是否成功应用。图像保存度涉及对象感知掩蔽技术和保存评分,以确保图像的非目标区域未被更改。还使用了人工标注的图像掩码。

该公司使用了跨越20个内容类别的一千个编辑样本来测试多个编辑模型的输出,例如MGIE、OmniGen和GPT-Image 1。在撰写本文时,OpenAI的GPT-Image-1被发现是性能最佳的模型。

苹果使用了详细的指令和编辑请求,包括让模型添加、移除、替换或更改物体的大小。模型还需要更改背景、修改布局等。

研究显示,GPT-Image-1产生了最理想的结果。然而,该模型在特定场景下确实会失败,例如不当或部分移除物体、误解布局更改请求或未能完全保存非目标区域。

研究指出:“总体而言,虽然GPT-Image-1在执行核心编辑方面非常强大,但它对空间关系和内容保存缺乏细粒度控制,为需要高精度或最小附带更改的任务留下了改进空间。”

与此同时,“OneDiffusion和MagicBrush在所有指标上 consistently 实现最高的保存分数。”总体而言,这为苹果提供了一种便捷的方法来测试其自身的图像生成模型或识别竞争产品的缺陷。

该公司已经拥有一个设备上的图像生成解决方案,称为Image Playground。它是苹果智能(Apple Intelligence)的一部分,这是一个AI驱动的功能套件,支持多种语言。

IMPACT:跨复杂类型的屈折形态学探针

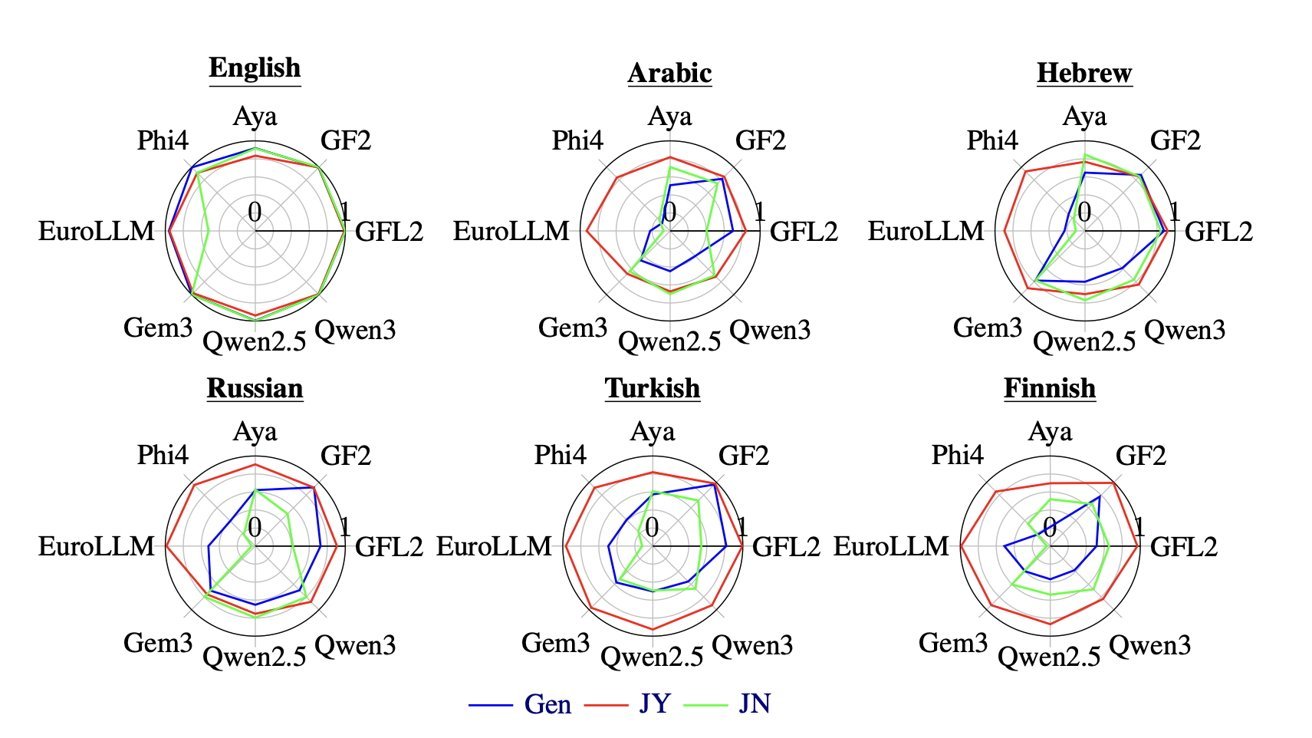

苹果的研究人员决定通过开发一个专注于屈折形态学的专用框架来评估AI模型在不同语言中的性能。

苹果创建了一个框架来评估LLM在形态丰富语言中的表现。

该公司的研究人员指出,AI模型通常难以处理形态丰富的语言,并表示“目前仍不清楚这些模型在多大程度上真正掌握了这些语言的底层语言复杂性。”

更具体地说,苹果的研究检验了LLM的性能以及它们是否根据阿拉伯语、俄语、芬兰语、土耳其语和希伯来语的屈折形态学生成输出。

屈折形态学与派生形态学相对,解释了语素如何用于改变单词以适应特定目的或语法结构。例如,后缀可用于传达语法功能,如名词的数或动词的时态等。

研究指出:“IMPACT包括单元测试风格的案例,涵盖共享和语言特定现象,从基本动词屈折变化(例如时态、数、性别)到独特特征,如阿拉伯语的反向性别一致以及芬兰语和土耳其语的元音和谐。”

该研究评估了八个多语言LLM的性能,指出它们“在其他语言和不常见形态模式上表现挣扎,尤其是在判断不合语法示例时。”

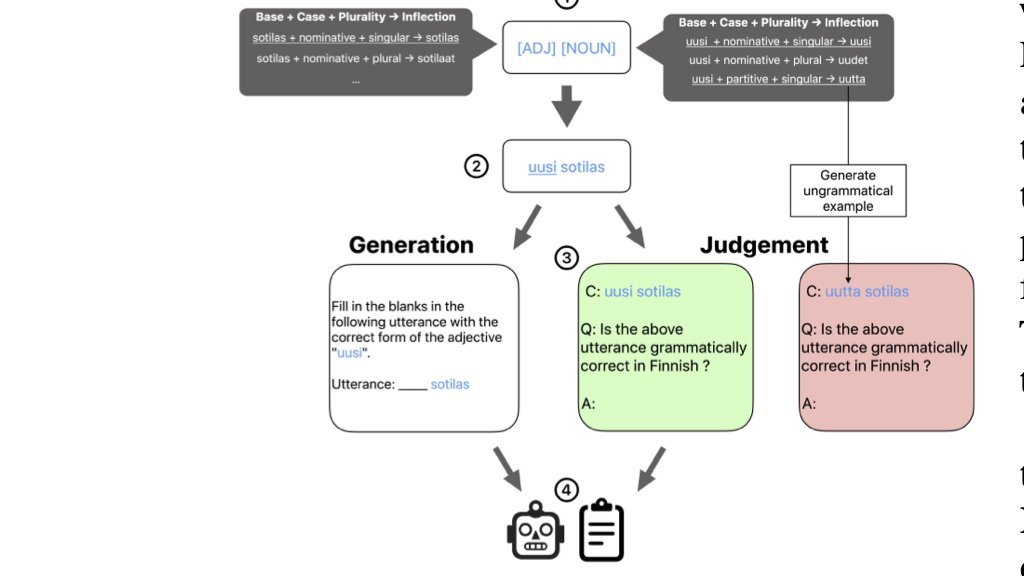

对于每种语言,苹果的研究人员决定“识别针对特定形态方面的模板,生成受控话语,并在两种场景中测试LLM。”这两种场景包括“一种是由LLM预测正确屈折形式(生成),另一种流行场景是LLM判断合语法和不合语法的话语。”

苹果的研究人员通过填空测试测试了AI模型。

实质上,AI模型被提供了详细说明某些语言在屈折形态学方面特定模式的模式。换句话说,哪些语素用于表示复数,或时态如何表达等。

然后,AI模型被要求完成填空类型的测试,它们需要根据周围词语应用先前概述的模式。

随后,LLM扮演“法官”的角色, tasked with 评估所提供的话语是否语法正确以及是否为本族语者会使用的内容。

苹果的研究人员概述了特定模型在每种语言中的失败之处。结果表明,大多数AI模型难以处理不常见的形态模式。尽管某些LLM在一种语言中表现优于另一种,但它们的表现均不如在英语中。

就实际意义而言,苹果可以采用IMPACT框架作为评估其内部模型性能的一种手段,特别是在处理形态复杂的语言时。

2025年,该公司宣布了其与AirPods配合使用的实时翻译功能。它提供实时翻译,使掌握不同语言的用户能够相对轻松地进行交流。

即使苹果最近的AI团队发生了变动,如前AI负责人约翰·詹南德雷亚退休,苹果并未放缓发布与人工智能相关的研究。该公司预计将在iOS 26.4更新中发布其延迟的情境感知版Siri。