以后用HomePod的时候,可能都不用喊出“Siri”这个词了。苹果正在研究一种通过视线检测来判断用户是否需要设备响应的方法。

家里如果有好几台苹果设备,你肯定遇到过这种情况:想让Siri在某个设备上回应,却总是搞错。当房间里同时有iPhone、iPad和HomePod mini时,苹果虽然有一套系统来判断你想用哪个,但经常不准。

而且,不是每个人都喜欢说“Siri”这个唤醒词,哪怕它已经比原来的“Hey Siri”简洁多了。你还是可以喊这两个词,但电视里的人物也行——节目里一句话稍微沾点边,就可能误触发Siri。

另外,有些时候用户根本不想用语音。比如离得比较远,或者当着别人面跟设备说话觉得尴尬。

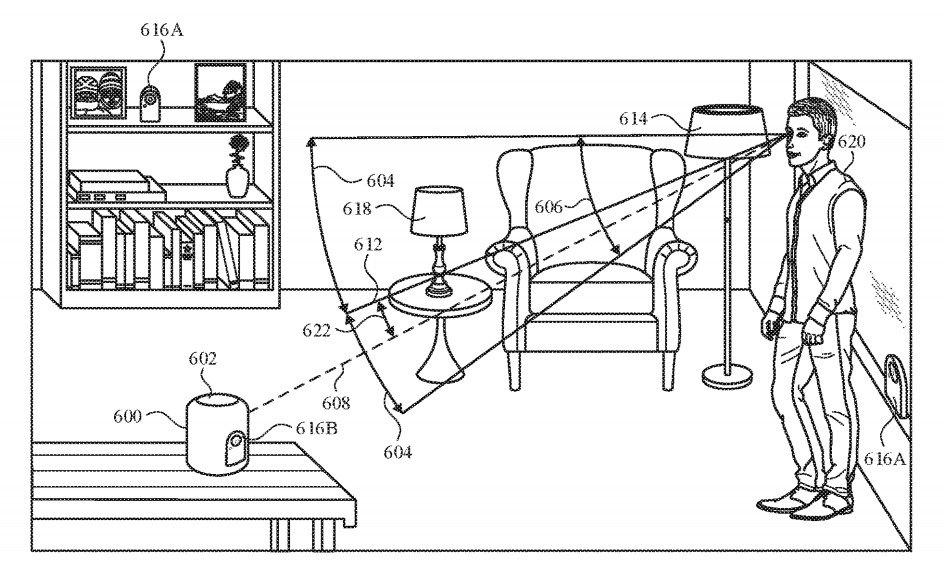

在一项刚刚授权的专利《利用视线信息控制设备》中,苹果提出可以通过视线来指挥Siri。具体来说,设备能检测用户是否在看它,从而判断用户是否想让它回应。

这需要HomePod或其他设备配备摄像头和传感器,能判断用户的位置和视线方向,搞清楚用户在看什么。然后就把被注视的设备切换到准备接收指令的状态,开始主动聆听。

这有点像iPhone的“始终显示”屏幕——平时其实是关闭的,只有你看过去才会亮起。也就是说,苹果已经有设备能检测是否被注视了。

苹果可以把这个功能扩展一下,把视线当成和喊“Siri”一样的触发方式。如果你没看设备,还是可以直接喊出来,但这样就多了一种选择。

用视线来判断用户是否想下指令还有其他好处。比如,确认用户真的在看设备,就能确定他是有意让设备执行命令。

专利里提到,HomePod的数字助理可能只有在用户看着它的时候,才会把听到的话当成指令来处理。

实际用起来,这就能避免把“放埃尔维斯”这样的随口话当成命令,而不是对话里的普通句子。

专利还说,光是看一眼不一定就会触发,需要满足一套“激活条件”。比如持续注视一秒左右,这样可以过滤掉无意的扫视或转头导致的误判。

用户头部的角度也很关键。比如设备放在床头柜上,用户躺在床上睡觉,脸虽然朝着设备,但头是侧着的,系统就可能不把它算作有效注视。

系统会综合判断眼睛是否睁开、头部角度等,避免无意间触发Siri。但这样也带来一个新问题。

如果设备不是每次注视都回应,用户就得知道它有没有被激活。总不能你说了一长串指令,结果Siri过会儿来一句“你是在跟我说话吗?”

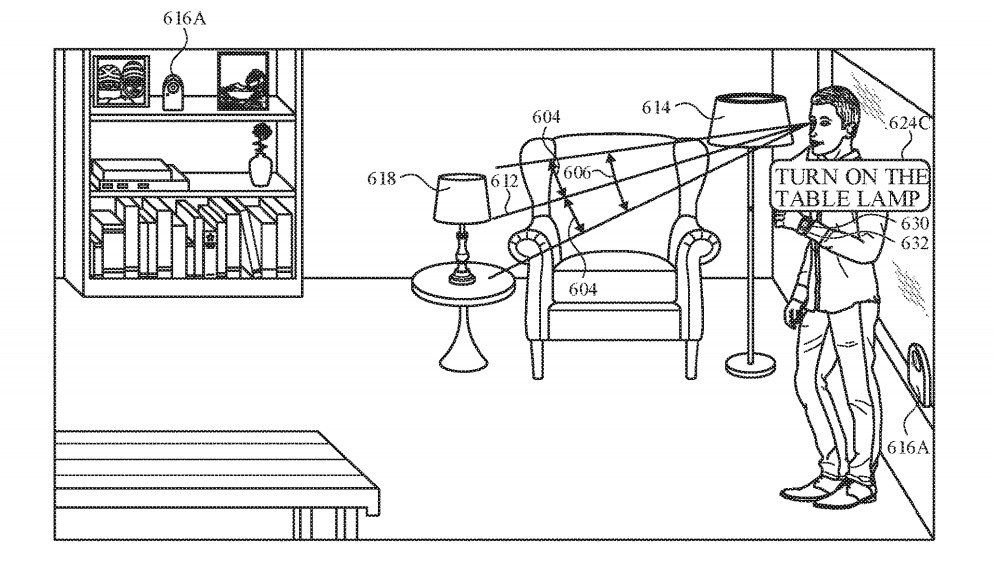

所以,当检测到有意的注视后,设备可以给出一些反馈,比如发出声音、亮起LED灯,或者在屏幕上显示提示,让用户知道助理已经激活。

有了视线检测功能,系统还能判断用户是不是在看房间里的其他可控物品,而不是只看装着助理的设备本身。

举个例子,用户看着房间里的某一盏灯,说出指令时,设备就能根据视线判断要打开哪一盏。

专利还描述了用户先开始说指令,再转头看向设备完成的情况,或者先看设备然后转开再说完的情况。

不管哪种,设备都要确定自己是被呼叫的对象。如果视线没及时检测到,苹果建议设备可以主动问用户想做什么,从而吸引注意力。

附近的设备可以检测用户对房间里其他可控物品的注视。

这已经不是苹果第一次申请类似远程操控设备的专利了。早在2015年就有关于“基于学习的双手和手指姿势估算”的专利,提到用光学3D映射系统识别手势,后来可能就用在了Apple Vision Pro上。

不过这个新专利也不是第一次被授权。它的早期版本在2019年提交,2020年就授权了。

苹果每年申请几百项专利,即使已经授权,也可能再提交改进版。可能是细节上有重要更新。

这次专利最早在2019年8月28日提交,这么多年过去,相关技术已经有部分落地。Face ID早在2017年的iPhone X就推出了,而更精准的视线检测则是Apple Vision Pro的重要功能。

当然,就算同一技术反复申请专利,也不能保证这个具体想法一定会实现。但专利里的示意图一直都在用HomePod,而且我们现在离真正带摄像头的HomeHub设备已经越来越近了。

这项专利的发明人是Sean B. Kelly、Felipe Bacim De Araujo E Silva和Karlin Y. Bark。