苹果工程师详细阐述了一款能精准描述街景画面的AI助手。若研究成功,该技术将成为视障群体提前虚拟探索目的地的新工具。

视障群体虽已配备设备导航和周边环境识别工具,但苹果认为提前获知目的地实景特征将更具价值。

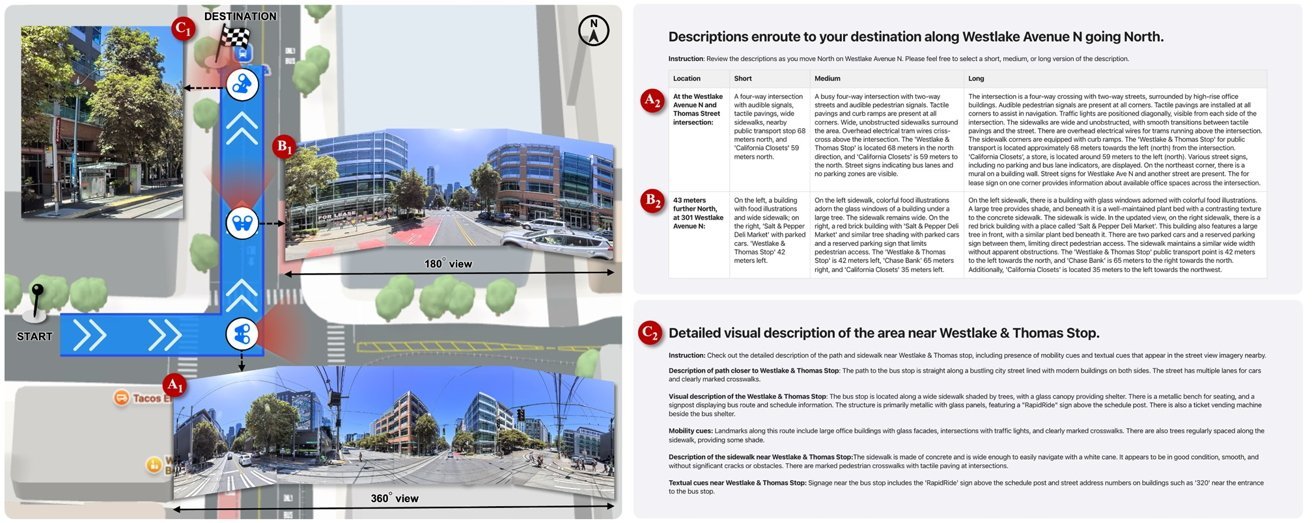

周一发布于苹果机器学习研究平台的论文介绍了SceneScout——基于多模态大语言模型的AI系统。其核心功能是解析街景图像,并向使用者进行场景描述。

该论文由苹果公司的Leah Findlater、Cole Gleason与哥伦比亚大学的Gaurav Jain共同撰写。

研究指出,视障人士在陌生环境中常因无法预知地形特征而怯于独自出行。

现有环境描述工具(如微软2018年推出的Soundscape应用)均局限于实时场景,无法实现预先勘察。

当前的行前指引仅提供地标转向等基础导航,缺乏景观语境信息。而苹果地图”环视”等街景功能包含的丰富视觉线索,恰恰是视障群体难以获取的。

SceneScout系统

SceneScout应运而生,通过街景图像实现无障碍交互。

系统具备两种模式:”路线预览”可告知沿途树木等触觉可辨的要素;”虚拟探索”则支持在街景中自由移动并实时播报环境特征。

测试表明,72%的场景描述准确率达95%,但偶现”微妙而合理的误差”需视觉辅助验证。

参与者建议系统应支持:1) 根据用户偏好提供个性化描述 2) 将视角从车顶摄像头切换至行人高度 3) 结合骨传导耳机实现实时环境播报 4) 利用陀螺仪替代摄像头进行方向识别。

未来应用

尽管该研究不意味着必然产品化,但揭示了苹果的技术布局方向。

传闻中配备摄像头的AirPods和Apple Glass智能眼镜,都可能搭载类似系统。通过实时影像(而非静态街景)为使用者提供环境描述。