若你曾听闻旗舰安卓设备的类似争议,这次谷歌Pixel 10 Pro的“Pro-Res Zoom”功能再次引发讨论——它并非通过镜头捕捉细节,而是依赖人工智能生成细节。

2025年8月发布的Pixel 10 Pro配备5倍光学变焦镜头,但超出这一范围后,其依赖人工智能技术。谷歌的“Pro-Res Zoom”通过扩散模型生成传感器从未记录的细节。

谷歌宣称支持10倍甚至100倍变焦,但超过5倍后,手机拍摄的已非真实场景,而是AI的推测结果。

网络上有用户注意到谷歌新手机的异常现象。作家John Scalzi在一篇题为《图片,非照片》的帖子中展示了这种效果。

谷歌的AI摄影技术无法清晰呈现细微文字。图片来源:John Scalzi

这让人联想到安卓与iOS相机理念的差异。谷歌在硬件不足时倾向于用AI填补细节,而苹果则避免生成不存在的像素。

谷歌变焦技术原理

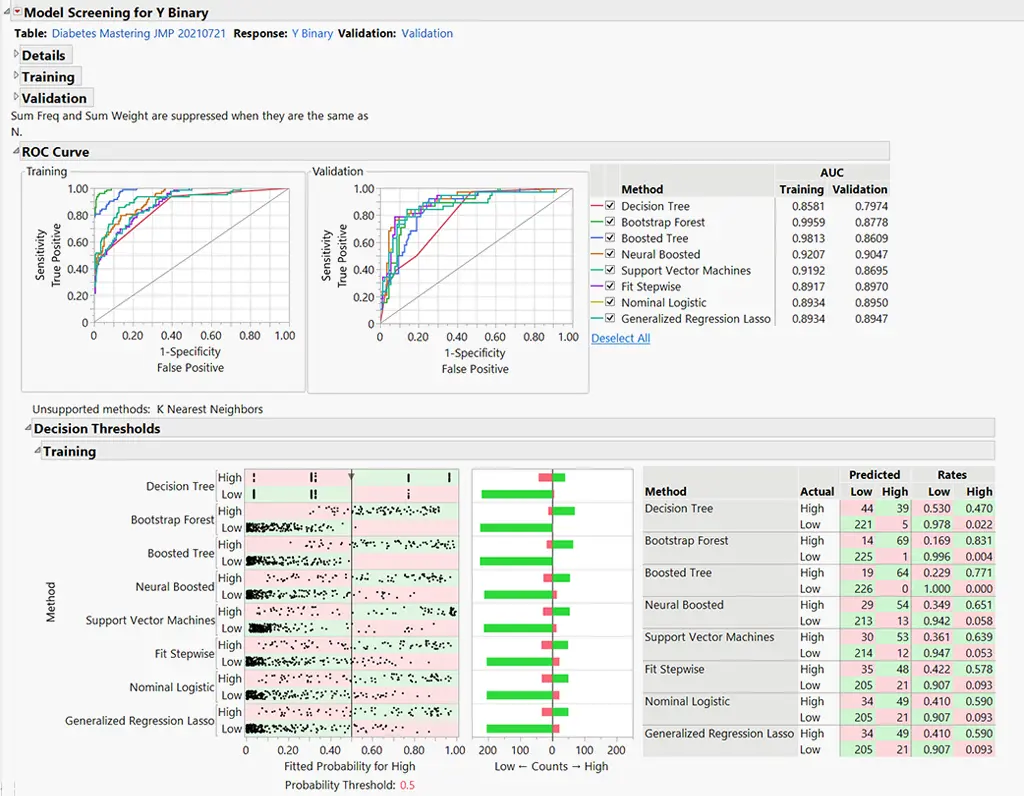

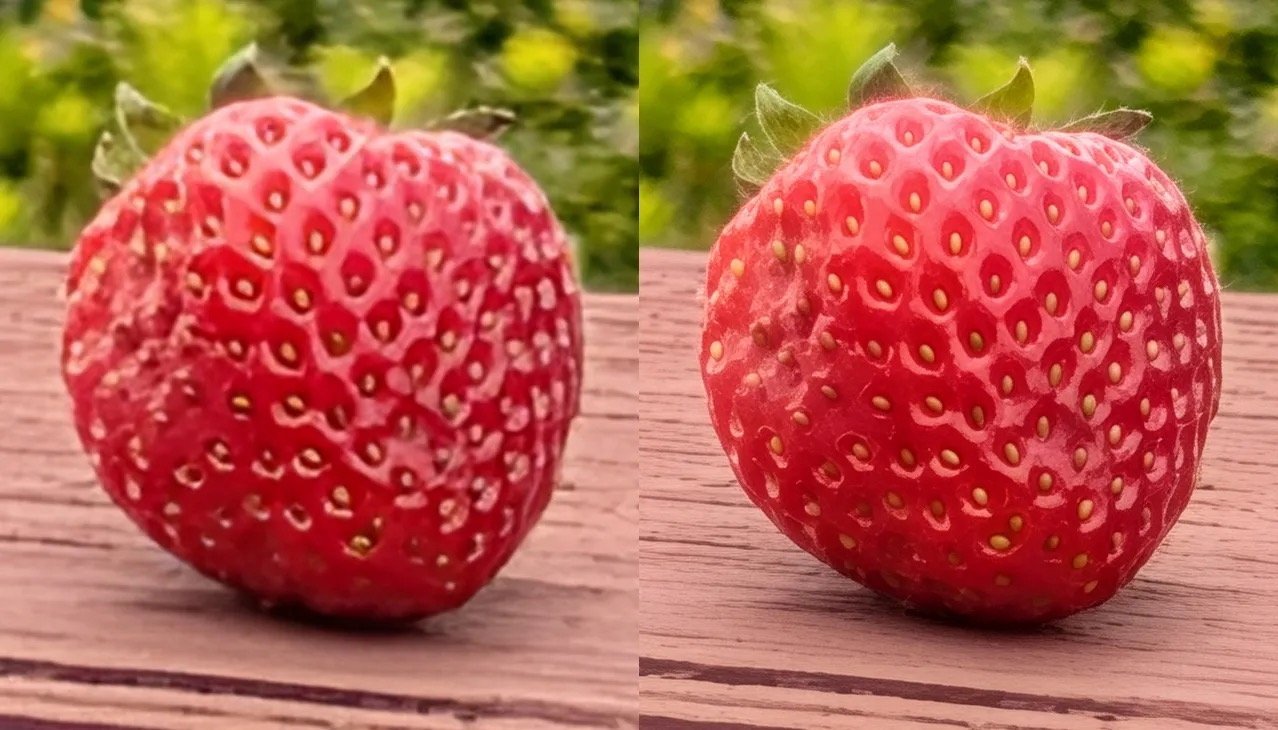

当拍摄对象简单(如水果或墙面砖块)时,AI能填充可信的图案;但面对复杂对象(如标志文字)时,这种假象便会崩塌。

左侧为自然数码变焦,右侧为谷歌AI生成效果。图片来源:John Scalzi

在5倍变焦内,Pixel 10 Pro依赖光学硬件。Scalzi指出,超出该范围后,手机会裁剪传感器画面并用AI放大,这一过程更接近艺术处理而非物理放大。

该技术源于Pixel早期的“夜视”和“超级分辨率变焦”功能,它们曾突破小传感器的极限。而“Pro-Res Zoom”更进一步,从增强转向了创造。

苹果近十年来一直采用计算摄影技术。2016年iPhone 7 Plus推出“人像模式”,利用深度数据和算法虚化背景。

苹果的摄影哲学

此后每代iPhone都通过机器学习合成曝光、平衡色调并降噪,iPhone 16 Pro延续了这一传统。

关键区别在于,苹果算法仅处理相机实际捕获的数据。系统可能调整天空颜色或减少暗光噪点,但不会凭空创造新像素。

苹果算法仅基于相机实际捕捉的数据工作。

公司的核心原则是“真实性与准确性”。即便是最先进的ProRAW格式,仍严格遵循传感器原始数据。

“月亮照片”争议的启示

2023年三星“月亮照片”丑闻中,“场景优化器”识别月亮并套用数据强化细节,最终图像实为合成而非拍摄。

谷歌“Pro-Res Zoom”在日常场景中面临类似问题。不同于月亮,没有数据库能预测路牌或电线的独特形状,导致图像被伪造。

苹果通过“人像模式”中的场景深度信息规避该问题。虽然涉及处理,但并非无中生有。

对普通用户而言,真实照片与AI生成图像的区别关乎信任。iPhone 17将继续推进算法优化,但不会创造不存在的细节。

这意味着你的照片仍能反映真实所见,即便经过降噪和曝光平衡处理。它或许无法提供魔幻的100倍变焦,但能保证iPhone照片是对现实的准确记录。